Der Kurznachrichtendienst X hat eine neue Regel eingeführt: Nutzer, die KI-generierte Videos eines „bewaffneten Konflikts“ veröffentlichen, ohne diese als solche zu kennzeichnen, werden ab sofort für 90 Tage vom Monetarisierungsprogramm ausgeschlossen. Bei wiederholten Verstößen riskieren sie einen dauerhaften Ausschluss aus dem Programm. Dies kündigte Produktchef Nikita Bier gestern in einem Beitrag auf X an.

Einschlägige Beiträge werden vom System durch die automatische Erkennung KI-basierter Metadaten oder von Nutzern selbst über Community-Notes als solche markiert, heißt es weiter in dem Beitrag.

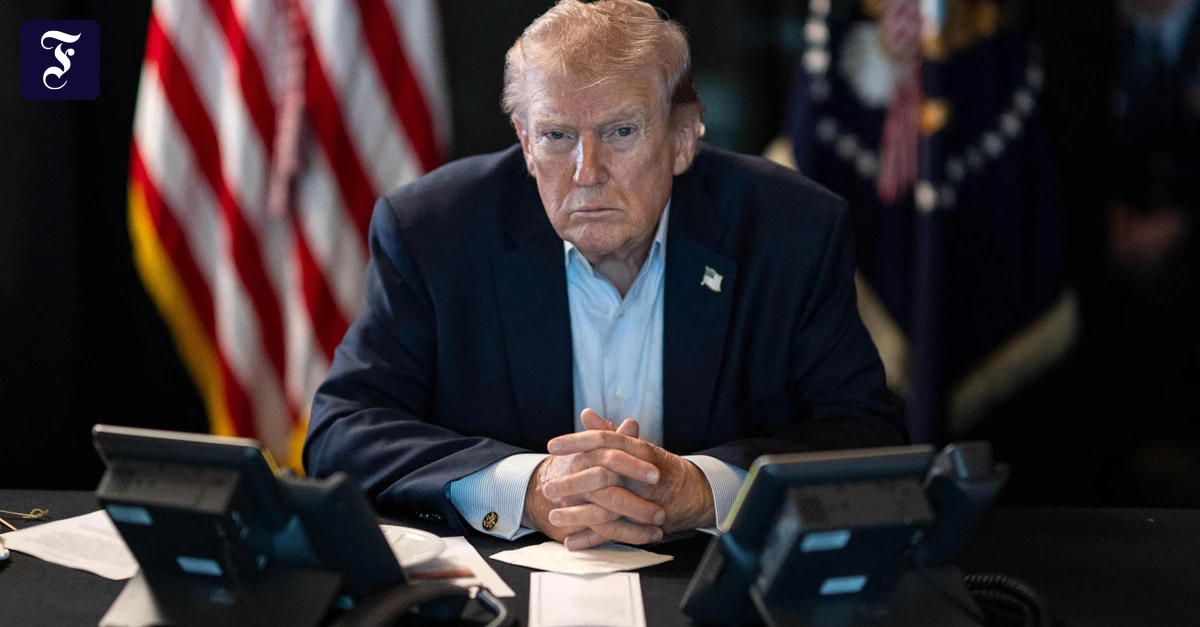

Die Regel ist von den aktuellen militärischen Auseinandersetzungen zwischen den USA, Israel und dem Iran motiviert. „In Kriegszeiten ist es entscheidend, dass Menschen Zugang zu verlässlichen Informationen vor Ort haben“, schreibt Bier. Mit den heutigen KI-Technologien sei es trivial, Inhalte zu erzeugen, die Menschen in die Irre führen können.

Die überwiegende Mehrheit der Nutzer ist von dieser Regel allerdings nicht betroffen und darf weiterhin folgenlos irreführende KI-Videos über den Konflikt oder andere Themen auf der Plattform veröffentlichen.

X arbeitet offenbar an Ausweitung der Kennzeichnungspflicht

Es ist das erste Mal, dass X eine Kennzeichnungspflicht ausdrücklich für KI-generierte Inhalte einführt. Aktuell betrifft sie jedoch nur „bewaffnete Konflikte“. Was genau darunter fällt, definiert Bier in seinem Beitrag nicht. In den offiziellen Plattformrichtlinien ist die neue Regel bislang nicht aufgeführt.

Weil KI-Slop auf X stark zugenommen hat, könnte die Regel künftig ausgeweitet werden. So entdeckte ein App-Entwickler (X-Link) im Februar, dass die Plattform an einer nutzerseitigen Kennzeichnungspflicht für KI-generierte Inhalte arbeitet. Entsprechende Pläne sind jedoch nicht bestätigt.

Mit dem eigenen KI-Chatbot Grok erstellte Bilder und Videos versieht X bereits automatisch mit einem Wasserzeichen. Verhindert hat das problematische Inhalte allerdings nicht. So sorgte der Chatbot in den vergangenen Monaten vor allem wegen mit ihm erzeugter sexualisierter Deepfakes für Schlagzeilen, was die EU dazu veranlasste, ein Verfahren gegen X einzuleiten. Der Fall zeigt, wie schwer sich X damit tut, KI-generierte Inhalte wirksam zu kontrollieren.

(tobe)

English (US) ·

English (US) ·